大数据技术基础 从硬件设施到数据处理全解析

大数据技术已经成为当今信息时代的核心驱动力之一。要深入理解大数据,首先需要掌握其依赖的基础硬件设施与核心概念。本文将以简洁明了的方式,带您快速入门大数据技术的基础架构层。

一、服务器:大数据计算的基石

服务器是大数据集群中的“大脑”和“肌肉”。它负责执行所有的计算任务。在大数据环境中,我们通常使用多台服务器组成集群,以分布式的方式处理海量数据。这些服务器可以分为主节点(如Hadoop中的NameNode)和工作节点(如DataNode)。主节点负责管理和协调,而工作节点负责存储数据和执行具体计算。服务器的性能(如CPU、内存)直接决定了数据处理的速度和效率。

二、存储磁盘:数据的家园

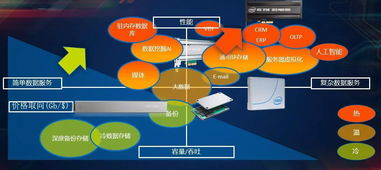

数据必须存储在物理介质上,这就是存储磁盘的作用。在大数据场景中,我们关注的不仅是磁盘的容量,更是其读写速度(IOPS)、可靠性和成本。机械硬盘(HDD)容量大、成本低,适合存储冷数据;固态硬盘(SSD)速度快、延迟低,适合存储需要频繁访问的热数据。分布式文件系统(如HDFS)会将大数据块切分,并冗余存储在多块磁盘甚至多台服务器上,以确保数据的安全和高可用性。

三、交换机:集群内部的“交通枢纽”

当数百甚至数千台服务器协同工作时,它们之间的数据通信至关重要。交换机就是负责连接集群内所有服务器的网络设备,它构成了数据高速流动的“神经网络”。大数据处理(如Shuffle阶段)会产生巨大的网络流量,因此大数据集群通常使用高带宽、低延迟的万兆或更高速率交换机,以确保节点间数据传输不会成为性能瓶颈。

四、网卡:服务器的网络门户

网卡(网络接口卡)是服务器与网络交换数据的关键硬件。它相当于服务器的“门户”,负责将服务器内部的数据转换成网络信号发送出去,并将接收到的网络信号转换回来。在大数据集群中,高性能的万兆网卡已成为标配,有些场景甚至使用速率更高或专用的RDMA网卡来进一步降低网络延迟,提升分布式计算效率。

五、IDC数据中心:基础设施的物理承载

IDC(互联网数据中心)是所有上述硬件设备的“家”。它是一个物理场所,提供稳定的电力供应(通常有双路市电和UPS、柴油发电机备份)、精密的环境控制(恒温恒湿的空调系统)、严密的物理安防和高速的网络接入。大数据集群就部署在IDC的机柜中。数据中心的规模、等级(如Tier III、Tier IV)和网络质量,直接决定了大数据服务的稳定性和可靠性。

六、磁盘阵列(RAID):了解即可

磁盘阵列(RAID)是一种通过将多块磁盘组合起来以提升性能、容量或可靠性的技术。例如,RAID 0通过条带化提升速度,RAID 1通过镜像提供数据冗余。在大数据领域,传统的RAID技术由于其扩展性和管理复杂度,在超大规模集群中应用有所减少。分布式系统(如HDFS)自身通过多副本机制在软件层面实现了数据冗余和高可用,其理念与RAID有相似之处,但架构层次更高、扩展性更强。因此,对于大数据学习者,了解RAID的基本原理有助于理解数据冗余思想即可。

七、核心:数据处理与存储支持服务

上述所有硬件设施,最终都是为了支撑上层的数据处理和存储服务。这才是大数据的核心价值所在。这些服务包括:

- 分布式存储服务:如HDFS、对象存储,提供海量、可靠、低成本的数据存储能力。

- 分布式计算框架:如MapReduce、Spark、Flink,负责对海量数据进行并行分析和处理。

- 资源管理与调度服务:如YARN、Kubernetes,负责高效、公平地管理集群的CPU、内存等资源,分配给不同的计算任务。

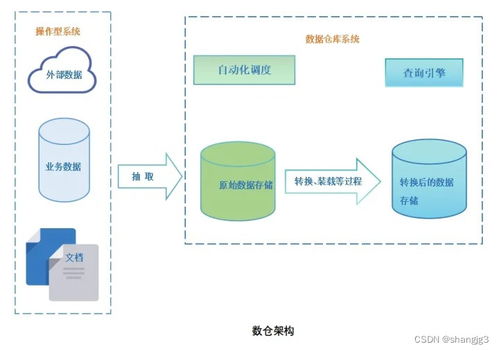

- 数据仓库与查询引擎:如Hive、Impala,提供类SQL的接口,方便对大数据进行查询分析。

- NoSQL数据库:如HBase、Cassandra,提供高并发、低延迟的随机数据读写能力。

这些软件服务构成了完整的大数据生态系统,使得我们能够从庞大的硬件集群中提炼出有价值的信息和洞察。

****

理解大数据,就像建造一座大楼,必须先打好地基。服务器、磁盘、网络、数据中心这些硬件基础设施就是大数据技术的地基。而磁盘阵列(RAID)等传统技术理念,则为理解现代分布式系统的设计思想提供了背景。所有硬件能力通过Hadoop、Spark等软件栈被整合起来,转化为强大的数据处理与存储服务,驱动着各行各业的智能化转型。

(注:文末提及的“qq 38454176的博客”为信息源提示,本文内容旨在进行通用性知识梳理与介绍。)

如若转载,请注明出处:http://www.shuduyouxi.com/product/54.html

更新时间:2026-05-31 15:51:54